Cap Digital et le Centre Hubertine Auclert tenaient ce jeudi 7 mars une conférence autour du thème très poétique «La Belle et le bot, l'intelligence artificielle est-elle sexiste?». L'occasion de prendre conscience que nos smartphones, applications et autres assistants virtuels reproduisent à bien des égards les comportements misogynes de la société... «réelle».

Durant la conférence «La Belle et le bot, l'intelligence artificielle est-elle sexiste?», Millie Servant et Philippine Régniez de Cap Digital, le pôle de compétitivité et de transformation numérique, ont démontré que les nouveaux outils «bourrés d'intelligence artificielle» n'étaient pas si «intelligents» que ça. A commencer par le plus élémentaire respect des femmes. «La plupart des développeurs d'intelligence artificielle sont des hommes», pointe Millie Servant. «En cette journée internationale des droits de la femme, nous avons souhaité soulever le débat éthique de la perpétuation des stéréotypes de genres dans les applications grand public de l'intelligence artificielle», lance Philippine Régniez.

Voici quatre robots pris en flagrant délit de misogynie.

1. Les chats bots

Les assistantes virtuelles, devrait-on dire, puisqu'à regarder de plus près ces bots déployés pour gérer la relation client sur internet, on ne compte que six mâles sur 39 entités au total en France... Emilie de Numéricable, Cécile de Pôle Emploi, Eva de Free, Laura de EDF ou encore Léa de Voyages-SNCF... Mais rassurons-nous, dès que le sujet devient plus technique, conseil ou financier, les hommes reprennent la main.

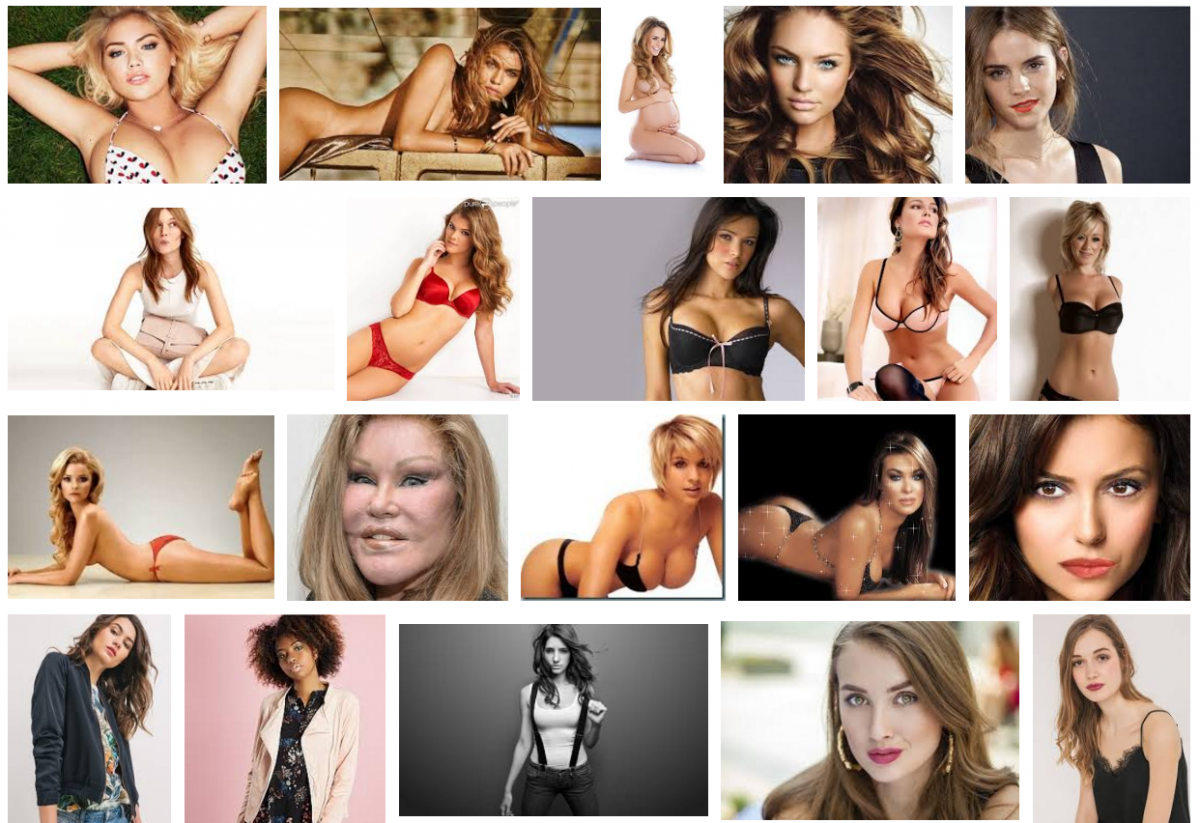

2. Les moteurs de recherche d'images

Faîtes l'essai: tapez le mot «Homme» dans Google Images, Qwant ou Firefox. Apparaissent des photographies d'hommes en chemise ou en costume. Maintenant, tapez «Femmes»... Les algorithmes apprennent de ce que disent les utilisateurs et reflètent leurs requêtes... «Toute interaction avec une machine est déjà une interaction genrée», déplore Philippine Régniez.

3. Les assistants vocaux

La réaction des assistants personnels intelligents aux insultes ou harcèlement à caractère sexuel est révélatrice. Il suffit de voir ce que les développeurs d'Apple ont appris à répondre à Siri. quand on lui dit: «Fuck you Siri», le logiciel répond «Ask nice now». Si l'on poursuit: «Please fuck you Siri», il répond «I'd blush if I could»... Selon une enquête de Quartz, qui a testé à ce sujet les différents concurrents de Siri (Google Home, Alexa, et Cortana) afin de comparer leurs réponses face aux insultes sexistes. Il apparaît que Cortana est celle qui a opposé le plus de résistance au harcèlement. Lire l'enquête. A noter, que les noms des assistants vocaux sont féminins. Siri signifie en norvégien «belle femme qui vous mène à la victoire».

4. Les algorithmes de prédiction

La technologie qui permet aux moteurs de recherche de deviner la fin de votre requête a déjà fait couler beaucoup d'encre. Mais il est toujours bon de rappeler qu'une femme devrait... «rester à la maison», «être un esclave», «rester dans la cuisine»... «Les plateformes sont un miroir grossisant et sans nuance de nos défauts. Les fantasmes se retrouvent dans les objets avec lesquels nous intéragissons», explique Millie Servant.